Datanode數據處理中心中的DataXceiver服務 核心組件與數據處理流程解析

在分布式文件系統(如HDFS)的架構中,DataNode作為數據存儲與I/O處理的基本單元,承擔著數據塊(Block)的存儲、讀寫與復制等核心任務。而DataXceiver服務,正是DataNode內部實現高效、可靠網絡數據傳輸的關鍵組件。本文將深入解析DataXceiver服務的角色、工作原理及其在數據處理流程中的重要性。

一、DataXceiver服務的核心角色

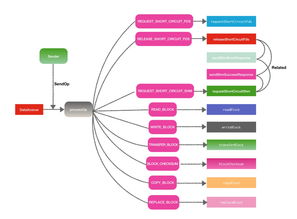

DataXceiver是DataNode中一個獨立的服務線程或線程池,專門負責處理所有通過TCP/IP協議流入和流出DataNode的數據傳輸請求。它并非處理元數據或管理命令(這些由其他服務如DataNode的IPC服務器處理),而是專注于實際數據塊的傳輸。其主要職責包括:

- 處理客戶端或其他DataNode的讀寫請求:當客戶端需要讀取或寫入數據時,最終會與目標DataNode的DataXceiver服務建立連接,進行數據塊的傳輸。

- 處理數據塊復制流水線(Pipeline)操作:在HDFS中,為了保證數據可靠性,一個數據塊通常會有多個副本。當寫入數據或進行副本重新均衡時,DataNode之間會形成一個數據傳輸流水線,DataXceiver服務負責在這個流水線中接收上游節點的數據并轉發給下游節點。

- 處理塊恢復和校驗操作:在數據塊損壞或副本數不足時,DataXceiver也參與副本復制和恢復過程中的數據傳輸。

二、數據處理流程剖析

以一次客戶端寫入請求為例,展示DataXceiver的工作流程:

1. 請求發起:客戶端從NameNode獲取文件對應的數據塊及其目標DataNode列表后,會直接與主DataNode(Pipeline中的第一個)的DataXceiver服務建立連接。

2. 流水線建立:主DataNode的DataXceiver會依次與列表中的下一個DataNode的DataXceiver建立連接,形成一個數據傳輸流水線。

3. 數據傳輸:客戶端將數據包發送給主DataNode的DataXceiver。DataXceiver在將數據包寫入本地磁盤的會將其轉發給流水線中的下一個DataNode的DataXceiver。下一個DataNode重復此過程,直至數據到達最后一個副本節點。這種流水線方式極大地提高了寫入吞吐量。

4. 應答返回:數據包沿流水線傳輸,確認信息(ACK)則反向傳回。客戶端從主DataNode收到整個數據塊寫入成功的確認。

讀取流程相對簡單:客戶端直接與某個持有目標數據塊的DataNode的DataXceiver建立連接,請求并接收數據塊內容。

三、DataXceiver的設計特點與優勢

- 協議優化:DataXceiver使用為HDFS高度定制的、基于TCP的二進制協議,避免了通用HTTP協議的開銷,傳輸效率更高。

- 資源隔離:作為獨立的服務,它與DataNode的管理命令處理服務分離,避免了I/O密集型的數據傳輸操作影響管理功能的響應。

- 高并發處理:通常采用線程池模型,能夠同時處理大量并發的數據傳輸連接,支撐集群的高并發訪問。

- 錯誤恢復機制:內置了完善的錯誤檢測與恢復邏輯,如在流水線傳輸中某個節點失敗,能觸發流水線重建,確保數據最終一致性。

四、

DataXceiver是DataNode數據處理中心的“引擎”,是HDFS實現高性能、高可靠數據存取的基礎。它抽象并封裝了底層復雜的數據網絡傳輸細節,為上層的文件讀寫、副本復制等操作提供了穩定高效的數據管道。理解DataXceiver的工作機制,對于優化HDFS集群性能、診斷數據傳輸相關問題具有關鍵意義。在大數據生態中,正是像DataXceiver這樣專注于單一職責的高效組件,共同支撐起海量數據的存儲與計算。

如若轉載,請注明出處:http://www.a6h0u7c9.cn/product/78.html

更新時間:2026-04-12 21:35:26